|

تضامنًا مع حق الشعب الفلسطيني |

اعتلاج (نظرية المعلومات)

اعتلاج (نظرية المعلومات) |

| نظرية المعلومات |

|---|

|

اعتلاج المعلومات (بالإنجليزية: information entropy) أو إنتروبي أو أنتروبيا، هي كمية أساسية في نظرية المعلومات مرتبطة بأي متغير عشوائي، والتي يمكن تفسيرها على أنها متوسط مستوى «المعلومات» أو «المفاجأة» أو «عدم اليقين» المتأصل في النتائج المحتملة للمتغير. تم تقديم مفهوم انتروبيا المعلومات من قبل كلود شانون في ورقته عام 1948 «نظرية رياضية في الاتصال».[1][2]

الإنتروبي هي القيمة المتوقعة للمعلومات الذاتية، وهي كمية ذات صلة قدمها شانون أيضًا. يقيس المعلومات الذاتية مستوى المعلومات أو المفاجأة المرتبطة بالنتيجة الواحدة المعينة أو حدث متغير عشوائي، في حين أن تقيس انتروبيا كم هو«مفيد» أو «مدهش» المتغير العشوائي كله، الذي بلغت متوسط كل نتائجه المحتملة.

تم إنشاء الإنتروبي في الأصل من قبل شانون كجزء من نظريته في الاتصال، حيث يتكون نظام اتصالات البيانات من ثلاثة عناصر: مصدر البيانات، وقناة اتصال، وجهاز استقبال. في نظرية شانون، إن «مشكلة الاتصال الأساسية» - كما عبر عنها شانون - هي أن يكون المتلقي قادرًا على تحديد البيانات التي تم إنشاؤها بواسطة المصدر، بناءً على الإشارة التي يتلقاها عبر القناة.[1][2] نظر شانون في طرق مختلفة لتعمية الرسائل وضغطها ونقلها من مصدر بيانات، وأثبت في نظريته الشهيرة لترميز المصدر أن الإنتروبيا تمثل حدًا رياضيًا مطلقًا حول كيفية ضغط البيانات من المصدر دون ضياع على قناة خالية من التشويش تمامًا. عزز شانون هذه النتيجة بشكل كبير للقنوات الصاخبة في نظرية الترميز ذات القناة الصاخبة.

يمكن تفسير الإنتروبيا أيضًا على أنها متوسط معدل إنتاج المعلومات من خلال مصدر احصائي للبيانات. عندما ينتج مصدر البيانات قيمة احتمالية منخفضة (على سبيل المثال، عند وقوع حدث احتمالية منخفضة)، يحمل الحدث «معلومات» أكثر مما ينتج عندما ينتج مصدر البيانات قيمة احتمالية عالية. يُمَثَّل مفهوم «المعلومات» رسميًا من خلال كمية المعلومات الذاتية لشانون، ويتم أيضًا تفسيرها أحيانًا على أنها «مفاجأة». ثم تصبح كمية المعلومات التي ينقلها كل حدث فردي متغيرًا عشوائيًا قيمته المتوقعة هي إنتروبيا المعلومات.

ليكن المتغير العشوائي ، مع النتائج المحتملة ، لكل منها احتمال انتروبي من على النحو التالي:

حيث هي المعلومات الذاتية المرتبطة بنتيجة معينة؛ هي المعلومات الذاتية للمتغير العشوائي بشكل عام، يعامل كمتغير عشوائي مشتق جديد؛ و هي القيمة المتوقعة لهذا المتغير العشوائي الجديد، وهي تساوي مجموع المعلومات الذاتية لكل نتيجة، ومرجحة باحتمال حدوث كل نتيجة [3]؛ و ، أساس اللوغاريتم، هو معلمة جديدة يمكن تعيينها بطرق مختلفة لتحديد اختيار الوحدات لإنتروبيا المعلومات.

يتم قياس انتروبي المعلومات عادة بوحدة البت (وتسمى بدلا من ذلك «شانون»)، الموافق أساس 2 في المعادلة المذكورة أعلاه. كما يتم قياسه أحيانًا «بوحدات طبيعية» (ناتس nats)، تقابل الأساس e أو الأرقام العشرية (تسمى "dits" أو "bans" أو " hartleys ")، المقابلة للأساس 10.

تعريف شانون فريد بشكل أساسي من حيث أنه هو الوحيد الذي له خصائص معينة: يتم تحديده بالكامل من خلال التوزيع الاحتمالي لمصدر البيانات، وهو اضافي للمصادر المستقلة، يتم تعظيمه في التوزيع الموحد، يتم تصغيره (وتساوي الصفر) عندما يكون هناك احتمال بنسبة 100٪ لحدوث حدث واحد فقط، ويطيع نسخة معينة مشتقة من قاعدة سلسلة الاحتمالات. يتم شرح الاشتقاقات البديهية للانتروبيا في الصفحة أدناه.

يتشابه تعريف الإنتروبيا المستخدم في نظرية المعلومات بشكل مباشر مع التعريف المستخدم في الديناميكا الحرارية الإحصائية، وهي علاقة تم تفصيلها في الصفحة إنتروبي في الديناميكا الحرارية ونظرية المعلومات.

المقدمة

الفكرة الأساسية لنظرية المعلومات هي أن «القيمة المعلوماتية» للرسالة التي يتم توصيلها تعتمد على درجة مفاجأة محتوى الرسالة. إذا كان الحدث محتملاً للغاية، فليس من المستغرب (و غير مهم بشكل عام) عندما يحدث هذا الحدث كما هو متوقع؛ وبالتالي فإن إرسال مثل هذه الرسالة يحمل القليل من المعلومات الجديدة. ومع ذلك، إذا كان من غير المحتمل حدوث حدث، فمن المفيد جدًا معرفة أن الحدث قد وقع أو سيحدث. على سبيل المثال، معرفة أن بعض الأرقام المحددة لن تكون الرقم الفائز في اليانصيب تقدم معلومات قليلة جدًا، لأن أي رقم محدد تم اختياره لن يكسب بالتأكيد. ومع ذلك، معرفة أن عدد معين سيفوز اليانصيب لها قيمة عالية لأنه يتصل مع نتيجة لحدث احتمال ضعيف جدا.

محتوى المعلومات (يسمى أيضًا المفاجأة) للحدث هي دالة متزايدة للتبادلية للاحتمال الحدث، على وجه التحديد . يقيس الانتروبيا الكمية المتوقعة (أي المتوسطة) من المعلومات المنقولة عن طريق تحديد نتيجة تجربة عشوائية. هذا يعني أن رمي النرد له إنتروبيا أعلى من رمي عملة معدنية لأن كل نتيجة لرمي النرد لها احتمال أقل (حول ) من كل نتيجة رمي عملة ().

الإنتروبيا هي مقياس لعدم القدرة على التنبؤ بالحالة، أو ما يعادلها من متوسط محتوى المعلومات . للحصول على فهم بديهي لهذه المصطلحات، فكر في مثال استطلاع سياسي. عادةً، تحدث مثل هذه الاستطلاعات لأن نتيجة الاستطلاع غير معروفة بالفعل. وبعبارة أخرى، فإن نتائج الاستطلاع غير متوقعة نسبيًا، كما أن إجراء الاستطلاع وتعلم النتائج يعطي بعض المعلومات الجديدة؛ هذه مجرد طرق مختلفة لقول أن الإنتروبيا الأولية لنتائج الاستطلاع كبيرة. الآن، ضع في اعتبارك حالة إجراء نفس الاستطلاع مرة أخرى بعد وقت قصير من الاستطلاع الأول. بما أن نتيجة الاستطلاع الأول معروفة بالفعل، يمكن توقع نتائج الاستطلاع الثاني بشكل جيد ويجب ألا تحتوي النتائج على معلومات جديدة كثيرة؛ في هذه الحالة، يكون الانتروبيا الأولية لنتائج الاستطلاع الثانية صغيرة بالنسبة إلى النتيجة الأولى.

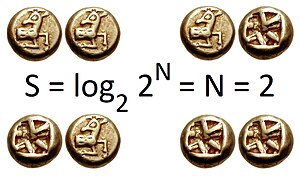

تأمل في مثال رمي العملة. إذا كان احتمال الرأس هو نفسه احتمال ذيول، فإن الإنتروبيا في رمي العملة عالية كما يمكن أن تكون لمحاكمة ذات نتيجتين. لا توجد طريقة للتنبؤ بنتائج رمي العملة في وقت مبكر: إذا كان على المرء أن يختار، فلا يوجد متوسط ميزة يمكن اكتسابها من خلال التنبؤ بأن الرمي سيخرج رؤوسًا أو ذيول، حيث سيكون أي توقع صحيحًا مع الاحتمال . مثل رمي العملة هذا لديه جزء من الانتروبيا حيث أن هناك نتيجتين محتملتين تحدثان باحتمالية متساوية، وتعلم النتيجة الفعلية تحتوي على جزء واحد من المعلومات. على النقيض من ذلك، فإن رمي العملة باستخدام عملة لها رأسان ولا ذيول لا يوجد أي إنتروبيا حيث أن العملة ستظهر دائمًا رؤوس، ويمكن توقع النتيجة بشكل مثالي. بالمقابل، فإن حدثًا ثنائيًا بنتائج قابلة للتوازن له إنتروبيا شانون قليلا. وبالمثل، يحتوي النظام الثلاثي trit واحد بقيم متساوية (حوالي 1.58496) بت من المعلومات لأنه يمكن أن يحتوي على واحدة من ثلاث قيم.

النص الإنجليزي، الذي يعامل كسلسلة من الأحرف، لديه إنتروبيا منخفض إلى حد ما، أي يمكن التنبؤ به إلى حد ما. إذا لم نكن نعرف بالضبط ما الذي سيأتي بعد ذلك، فيمكننا أن نكون على يقين إلى حد ما، على سبيل المثال، "e" ستكون أكثر شيوعًا بكثير من "z"، وأن المجموعة "qu" ستكون أكثر شيوعًا من أي شيء آخر بالاشتراك مع "q"، وأن النسخة "th" ستكون أكثر شيوعًا من "z" أو "q" أو "qu". بعد الحروف القليلة الأولى، يمكن للمرء في كثير من الأحيان أن يخمن بقية الكلمة. يحتوي النص الإنجليزي على ما بين 0.6 و 1.3 بت من الإنتروبيا لكل حرف في الرسالة.[4] :234

إذا كان نظام الضغط بدون خسارة - حيث يمكنك دائمًا استرداد الرسالة الأصلية بالكامل عن طريق إزالة الضغط - عندئذٍ تحتوي الرسالة المضغوطة على نفس كمية المعلومات مثل الأصل، ولكن يتم توصيلها بأحرف أقل. لديها المزيد من المعلومات (إنتروبيا أعلى) لكل حرف. تحتوي الرسالة المضغوطة على تكرار أقل. تنص نظرية شاندون لترميز المصدر على أن نظام الضغط بدون خسارة لا يمكنه ضغط الرسائل، في المتوسط، للحصول على أكثر من بت واحد من المعلومات لكل بت من الرسالة، ولكن يمكن تحقيق أي قيمة أقل من بت واحد من المعلومات لكل بت من الرسالة عن طريق استخدام مخطط مناسب للترميز. إن إنتروبية الرسالة لكل بت مضروبة في طول تلك الرسالة هو مقياس لمقدار المعلومات الإجمالية التي تحتوي عليها الرسالة.

إذا كان على المرء أن يرسل تسلسلات تشتمل على الأحرف الأربعة "A" و "B" و "C" و "D"، فقد تكون الرسالة المرسلة "ABADDCAB". تعطي نظرية المعلومات طريقة لحساب أصغر كمية ممكنة من المعلومات التي ستنقل ذلك. إذا كانت جميع الأحرف الأربعة متساوية (25٪)، فلا يمكن للمرء أن يقوم بأفضل (عبر قناة ثنائية) من أن يكون له ترميز 2 بت (عبر قناة ثنائية) كل حرف: "A" قد يرمز إلى "00"، "B" كـ "01" و "C" كـ "10" و "D" كـ "11". في حالة حدوث "A" باحتمال 70٪، و "B" بنسبة 26٪، و "C" و "D" بنسبة 2٪ لكل منهما، يمكن للمرء تعيين رموز طول متغيرة، بحيث استقبال "1" يقول لنا أن ننظر في بت آخر ما لم يتم بالفعل استقبال بت 2 من المتسلسلة 1s. في هذه الحالة، يتم ترميز "A" كـ "0" (بت واحد) و "B" كـ "10" و "C" و "D" كـ "110" و "111". من السهل ملاحظة أن 70٪ من الوقت يحتاج إلى إرسال بت واحد فقط، و 26٪ من الوقت بتين، و 4٪ فقط من الوقت 3 بتات. في المتوسط، يلزم أقل من 2 بت لأن الإنتروبيا أقل (بسبب الانتشار الواسع لـ "A" متبوعًا بـ "B" - معًا 96٪ من الأحرف). حساب مجموع الاحتمالية الموزنة للوغاريتم الخاص بالاحتمالات المقاسة والمأخوذة لهذا التأثير.

تفترض نظرية شانون أيضًا أنه لا يوجد نظام ضغط بدون خسارة المخطط يمكن أن يقصر جميع الرسائل. إذا كانت بعض الرسائل أقصر، فيجب أن تظهر رسالة واحدة على الأقل لفترة أطول بسبب مبدأ ثقب برج الحمام. في الاستخدام العملي، هذه ليست مشكلة بشكل عام، لأن المرء عادة ما يهتم فقط بضغط أنواع معينة من الرسائل، مثل مستند باللغة الإنجليزية، على عكس نص لطلاسم أو صور رقمية بدلاً من الضجيج، وهو غير مهم إذا كانت خوارزمية الضغط تجعل بعض التسلسلات غير المتوقعة أو غير المثيرة للاهتمام أكبر.

تعريف

سميت نظرية شانون باسم نظرية بولتزمان، وقد عرّف شانون الانتربي Η (Η اليوناني الكبير eta) لمتغير عشوائي متقطّع مع القيم المحتملة ووظيفة الكتلة الاحتمالية مثل:

هنا هو عامل القيمة المتوقعة، I هو محتوى معلومات X [5] :11 [6] :19–20 هو نفسه متغير عشوائي.

يمكن كتابة الأنتربي بشكل صريح كـ

|

|

حيث b هي أساس اللوغاريتم المستخدم. القيم الشائعة لـ b هي 2، رقم أويلر e ، و 10، والوحدات المقابلة من الإنتروبيا هي البتات لـ b = 2 ، nats لأجل b = e، bans لـ b = 10.[7]

في حالة P(xi) = 0 بالنسبة لبعض i ، تُعتبر قيمة التلخيص المقابل (corresponding summand)؛0 logb(0) هي 0 ، وهو ما يتوافق مع النهاية:

يمكن للمرء أيضًا تعريف الإنتروبي الشرطي لحدثين و أخذ القيم و على التوالي

حيث هو احتمال ذلك و . يجب فهم هذه الكمية على أنها مقدار العشوائية في المتغير العشوائي بالنظر إلى المتغير العشوائي .

مثال

هنا، يكون الإنتروبيا 1 بت على الأكثر، وسيتطلب توصيل نتيجة قلب العملة (قيمتان محتملتان) متوسط 1 بت على الأكثر (1 بت بالضبط لعملة عادلة). تتطلب نتيجة الموت العادل (6 قيم محتملة) في المتوسط 2 بت 2 6 بت.

ضع في اعتبارك رمي عملة معدنية باحتمالات ظهور رؤوس أو ذيول، وليس بالضرورة عملة عادلة؛ يمكن نمذجة هذا على أنه عملية برنولي.

يتم تكبير الانتروبيا للنتيجة غير المعروفة للرمي التالي للعملة إذا كانت العملة عادلة (أي إذا كان لكل من الرؤوس والذيول احتمال متساوي 1/2). هذا هو وضع الحد الأقصى من عدم اليقين حيث يصعب التنبؤ بنتيجة الرمي التالي؛ نتيجة كل رمية لعملة واحدة توفر بت كامل من المعلومات. هذا بسبب

ومع ذلك، إذا كنا نعلم أن العملة ليست عادلة، ولكن تأتي برؤوس أو ذيول مع الاحتمالات p و q ، حيث p ≠ q ، فهناك قدر أقل من عدم اليقين. في كل مرة يتم رميها، من المرجح أن يأتي أحد الجانبين أكثر من الآخر. يتم قياس عدم اليقين المنخفض في إنتروبيا أقل: في المتوسط تقدم كل رمية للعملة أقل من بت كامل من المعلومات. على سبيل المثال، إذا كانت p = 0.7، إذن

ينتج عن الاحتمال الموحد أقصى قدر من عدم اليقين وبالتالي أقصى انتروبيا. الإنتروبيا، إذن، يمكن أن تنخفض فقط من القيمة المرتبطة بالاحتمال المنتظم. الحالة القصوى هي عملة ذات رأسين لا تظهر ذيولًا أبدًا، أو عملة ذات ذيل مزدوج لا ينتج عنها رأس أبدًا. ثم ليس هناك شك. انتروبي هو صفر: كل رمية للعملة لا تقدم أي معلومات جديدة حيث تكون نتيجة كل رمية للعملة مؤكدة دائمًا.

يمكن تطبيع الانتروبيا بتقسيمها على طول المعلومات. تسمى هذه النسبة انتروبي المتري وهي مقياس لعشوائية المعلومات.

الأساس المنطقي

لفهم معنى -∑ pi log(pi) ، قم أولاً بتعريف دالة المعلومات I من حيث الحدث i مع الاحتمال pi . كمية المعلومات المكتسبة نتيجة لمراقبة الحدث i التالي من حل شانون الأساسي للخصائص من المعلومات:[8]

- I(p) هو دالة رتيبة في p. الزيادة في احتمالية حدث يثلل المعلومات من الحذف المراقب، والعكس بالعكس.

- I(p) ≥ 0 : المعلومات ليست كمية سالبة.

- I(1) = 0 : الأحداث التي تحدث دائماً لا توصل معلومات.

- I(p1 p2) = I(p1) + I(p2) : المعلومات عبر الاحداث المستقلة هي جمعية.

الأخير هو خاصية حاسمة. وينص على أن الاحتمال المشترك للمصادر المستقلة للمعلومات ينقل الكثير من المعلومات مثل الحدثين الفرديين بشكل منفصل. خاصةً، إذا كان الحدث الأول يمكن أن يسفر عن واحدة من n متوازن النتائج وآخر واحدة من m متوازن نتائج ثم هناك نتائج mn المحتملة لهذا الحدث المشترك. هذا يعني أنه إذا كانت هناك حاجة إلى بتات log2(n) لتعمية القيمة الأولى log2(m) لترميز الثانية، يحتاج المرء إلى log2(mn) = log2(m) + log2(n) لترميز كليهما . اكتشف شانون أن الاختيار الصحيح للدالة لقياس المعلومات، والحفاظ على هذه الإضافة، هو لوغاريتمي، أي

لتكن هي دالة المعلومات التي يفترض المرء أنها قابلة للتمييز باستمرار مرتين، وعليه:

هذه المعادلة التفاضلية تؤدي إلى الحل لأي . شرط 2. يؤدي إلى وخاصة، يمكن اختياره في النموذج مع ، وهو ما يعادل اختيار أساس محدد للوغاريتم. مختلف وحدات المعلومات (بت لوغاريتم ثنائي log2 ناتس لل اللوغاريتم الطبيعي ln bans للوغاريتم العشري log10 وهلم جرا) هي مضاعفات ثابتة من بعضها البعض. على سبيل المثال، في حالة رمي عملة عادلة، توفر الرؤوس log2(2) = 1 بت من المعلومات، وهو ما يقرب من 0.693 ناتس أو 0.301 أرقام عشرية. بسبب الجمع، وتوفر n n رميات من بت من المعلومات، وهو ما يقرب من 0.693n ناتس أو 0.301n رقما 0.301n عشري.

إذا كان هناك توزيع حيث حدث i أن يحدث مع احتمال pi وتم أخذ عينات N مرات مع نتائج i تحدث ni = N pi مرات ni = N pi فإن المبلغ الإجمالي من المعلومات التي تلقيناها من

- .

وبالتالي فإن متوسط كمية المعلومات التي نتلقاها لكل حدث هو

نتيجة لما سبق، وبسبب استخدام اللوغاريتم في التعريف المشتق للانتروبيا، فإن الإنتروبيا مضافة أيضًا للمصادر المستقلة. على سبيل المثال، وانتروبي من رمية عملة عادلة هو 1 بت، وانتروبي من قذفات m هو m بت. في تمثيل مباشر، هناك حاجة ل log2(n) بت لتمثيل متغير الذي يمكن أن يأخذ واحدة من القيم n إذا كان n هو قوة 2، والذي هو n = 2k إذا كانت هذه القيم مُحتمَلة بنفس القدر، فإن الإنتروبيا (بالبتات) تساوي log2(n)= k . إذا كانت إحدى القيم أكثر احتمالية لحدوثها من القيم الأخرى، فإن ملاحظة أن هذه القيمة تحدث تكون أقل إفادة مما لو حدثت بعض النتائج الأقل شيوعًا. على العكس من ذلك، توفر الأحداث النادرة مزيدًا من المعلومات عند ملاحظتها. نظرًا لأن ملاحظة الأحداث الأقل احتمالًا تحدث بشكل أكثر ندرة، فإن التأثير الصافي هو أن الإنتروبيا (التي يُعتقد أنها متوسط المعلومات) الواردة من البيانات غير الموزعة بشكل منتظم تكون دائمًا أقل من أو تساوي log2(n). الانتروبيا هي صفر عندما تكون هناك نتيجة واحدة مؤكدة. تحدد الأنتروبيا هذه الاعتبارات عندما يُعرّف التوزيع الاحتمالي لبيانات المصدر. المعنى من الأحداث التي تمت ملاحظتها (معنى الرسائل) لا يهم في تعريف انتروبي. تأخذ إنتروبي بعين الاعتبار فقط احتمال ملاحظة حدث معين، لذا فإن المعلومات التي تتضمنها هي معلومات حول توزيع الاحتمال الأساسي، وليس معنى الأحداث نفسها.

اعتبارات

العلاقة مع الانتروبيا الديناميكية الحرارية

جاء الإلهام لاعتماد كلمة انتروبي في نظرية المعلومات من التشابه الوثيق بين صيغة شانون والصيغ المعروفة جدًا من الميكانيكا الإحصائية.

في الديناميكا الحرارية الإحصائية، الصيغة الأكثر شيوعًا للانتروبيا الديناميكية الحرارية S لنظام الديناميكا الحرارية هي إنتروبي جيبس،

حيث kB هي ثابت بولتزمان، و pi هي احتمالية الحالة في حجم المايكرو (ميكروستت). النتروبي جيبس كان معرف من قبل ج.ويلارد جيبس في عام 1878 بعد عمل سابق من قبل بولتزمان 1872.

تترجم إنتروبس جيبس بشكل غير متغير تقريبًا إلى عالم فيزياء الكم لإعطاء انتروبي فون نيومان، الذي قدمه جون فون نيومان في عام 1927،

حيث ρ هي مصفوفة كثافة النظام الميكانيكي الكمومي و Tr هو الأثر.

على المستوى العملي اليومي ، الروابط بين إنتروبيا المعلومات وإنتروبيا الديناميكا الحرارية ليست واضحة. يميل الفيزيائيون والكيميائيون إلى أن يكونوا أكثر اهتمامًا بالتغيرات في الإنتروبيا حيث يتطور النظام تلقائيًا من ظروفه الأولية ، وفقًا للقانون الثاني للديناميكا الحرارية، بدلاً من التوزيع الاحتمالي الذي لا يتغير. كما يشير الدقيق (minuteness) من ثابت بولتزمان kB ، التغييرات في S / kB للكميات حتى الصغيرة من المواد في العمليات الكيميائية والفيزيائية تمثل كميات الانتروبي التي تكون كبيرة للغاية بالمقارنة مع أي شيء في ضغط البيانات أو معالجة الإشارات. في الديناميكا الحرارية الكلاسيكية ، يتم تعريف الإنتروبيا من حيث القياسات العيانية ولا تشير إلى أي توزيع احتمالي ، وهو أمر أساسي لتعريف إنتروبيا المعلومات.

تم الربط بين الديناميكا الحرارية وما يعرف الآن باسم نظرية المعلومات لأول مرة بواسطة لودفيج بولتزمان وتم التعبير عنها بواسطة معادلته الشهيرة :

حيث هو الانتروبيا الديناميكية الحرارية الميكروستت (macrostate) المعينة (معرّف بمعلمات ديناميكية حرارية مثل درجة الحرارة والحجم والطاقة وما إلى ذلك.)، W هو عدد الميكروستات (مجموعات مختلفة من الجسيمات في حالات الطاقة المختلفة) التي يمكن أن تنتج ماكروستات معين ، و KB هو ثابت بولتزمان. يُفترض أن كل ميكروستات متساوٍ على الأرجح ، بحيث يكون احتمال أي ميكروستات معين هو pi = 1/W. عندما يتم استبدال هذه الاحتمالات في التعبير أعلاه الجيبس انتروبي (أو ما يعادل kB ضرب إنتروبيا شانون)، نتائج معادلة بولتزمان. من حيث النظرية المعلوماتية ، فإن إنتروبيا المعلومات في النظام هي كمية المعلومات «المفقودة» اللازمة لتحديد ميكروستت (microstate)، بالنظر إلى الماكروستت.

في رأي جاينس (1957)، يجب النظر إلى الانتروبي الحراري الديناميكي ، كما هو موضح بواسطة الميكانيكا الإحصائية، كتطبيق لنظرية المعلومات لشانون: يتم تفسير الانتروبي الديناميكي الحراري على أنه يتناسب مع كمية معلومات شانون الإضافية اللازمة لتحديد حالة المجهر التفصيلي microscopic state للنظام، التي لا تزال غير موصوفة من خلال وصف فقط من حيث المتغيرات المجهرية للديناميكا الحرارية الكلاسيكية ، مع انتروبي ثابت التناسب ليس الا ثابت بولتزمان. تؤدي إضافة الحرارة إلى النظام إلى زيادة الإنتروبيا الديناميكية الحرارية لأنه يزيد من عدد الحالات المجهرية المحتملة للنظام التي تتوافق مع القيم القابلة للقياس لمتغيراته العيانية ، مما يجعل أي وصف كامل للحالة أطول. (انظر المادة: الديناميكا الحرارية القصوى الانتروبيا). يمكن أن يقلل شيطان ماكسويل (افتراضيًا) من الانتروبيا الديناميكية الحرارية للنظام باستخدام معلومات حول حالات الجزيئات الفردية (individual molecules)؛ ولكن ، كما أظهر لانداور (من عام 1961) وزملاءه في العمل ، لكي يعمل الشيطان نفسه يجب أن يزيد من الانتروبيا الديناميكية الحرارية في هذه العملية ، على الأقل من خلال كمية معلومات شانون التي يقترح الحصول عليها وتخزينها أولاً ؛ وبالتالي فإن الانتروبيا الديناميكية الحرارية الكلية لا تقل (مما يحل التناقض). يفرض لانداورمبدأ لانداور حدًا أدنى على كمية الحرارة التي يجب أن يولدها الكمبيوتر لمعالجة كمية معينة من المعلومات ، على الرغم من أن أجهزة الكمبيوتر الحديثة أقل كفاءة بكثير.

الانتروبيا كمحتوى للمعلومات

يتم تعريف الانتروبيا في سياق نموذج احتمالي. تقلبات عملة عادلة مستقلة لها إنتروبيا 1 بت لكل قلبة. المصدر الذي يولد دائمًا سلسلة نصية طويلة من B يحتوي على إنتروبيا من 0، حيث أن الحرف التالي سيكون دائمًا "B".

معدل الإنتروبيا لمصدر بيانات يعني متوسط عدد البتات لكل رمز اللازمة لتعمية ه. تُظهر تجارب شانون مع المتنبئين البشريين معدل معلومات يتراوح بين 0.6 و 1.3 بت لكل حرف باللغة الإنجليزية؛ [9] يمكن لخوارزمية ضغط PPM أن تحقق نسبة ضغط تبلغ 1.5 بت لكل حرف في النص الإنجليزي.

من المثال السابق ، لاحظ النقاط التالية:

- مقدار الانتروبي ليس دائمًا عددًا صحيحًا من البتات.

- قد لا تنقل العديد من بتات البيانات معلومات. على سبيل المثال ، غالبًا ما تقوم هياكل البيانات بتخزين المعلومات بشكل متكرر ، أو تحتوي على أقسام متطابقة بغض النظر عن المعلومات الموجودة في هياكل البيانات.

تعريف شانون للانتروبيا ، عند تطبيقه على مصدر المعلومات ، يمكن أن يحدد الحد الأدنى لسعة القناة المطلوبة لنقل المصدر بشكل موثوق كأرقام ثنائية مشفرة (انظر التحذير أدناه بخط مائل). يمكن اشتقاق الصيغة عن طريق حساب التوقع الرياضي لمقدار المعلومات الواردة في رقم من مصدر المعلومات. انظر أيضًا نظرية شانون هارتلي .

تقيس إنتروبيا شانون المعلومات الواردة في الرسالة بدلاً من الجزء المحدد من الرسالة (أو الذي يمكن التنبؤ به). تشمل الأمثلة الأخيرة التكرار في بنية اللغة أو الخصائص الإحصائية المتعلقة بترددات حدوث أزواج الحروف أو الكلمات، والثلاثيات (triplets) وما إلى ذلك. انظر سلسلة ماركوف.

الانتروبيا كمقياس للتنوع

الانتروبيا هي واحدة من عدة طرق لقياس التنوع. على وجه التحديد ، فإن إنتروبي شانون هو لوغاريتم 1D ، وهو مؤشر التنوع الحقيقي ببارامتر تساوي 1.

ضغط البيانات

يحيط الانتروبي بشكل فعال بأداء أقوى ضغط بدون خسارة ممكنة ، والذي يمكن تحقيقه نظريًا باستخدام المجموعة النموذجية أو في الممارسة العملية باستخدام ترميز هوفمان أو Lempel – Ziv أو التعمية الحسابي . انظر أيضًا تعقيد كولموجوروف . من الناحية العملية ، تتضمن خوارزميات الضغط عمداً بعض التكرار الحكيم في شكل اختباري للحماية من الأخطاء.

القدرة التكنولوجية في العالم على تخزين ونقل المعلومات

تقدر دراسة عام 2011 في العلوم القدرة التكنولوجية العالمية على تخزين وايصال المعلومات المضغوطة بشكل مثالي المقيسة على أكثر خوارزميات الضغط فاعلية المتاحة في عام 2007، وبالتالي تقدير إنتروبيا المصادر المتاحة تقنيًا.[10] :60–65

| نوع المعلومات | 1986 | 2007 |

|---|---|---|

| تخزين | 2.6 | 295 |

| بث | 432 | 1900 |

| الاتصالات | 0.281 | 65 |

يقدر المؤلفون القدرة البشرية على تخزين المعلومات (مضغوطة بالكامل انتروبياً) في عام 1986 ومرة أخرى في عام 2007. يقسمون المعلومات إلى ثلاث فئات - لتخزين المعلومات على وسيط ، لتلقي المعلومات من خلال شبكات البث أحادية الاتجاه ، أو لتبادل المعلومات من خلال شبكات الاتصالات ثنائية الاتجاه.[10]

حدود الانتروبيا كمحتوى المعلومات

هناك عدد من المفاهيم المتعلقة بالأنتروبيا التي تحدد كمية محتوى المعلومات رياضياً بطريقة ما:

- المعلومات الذاتية لرسالة أو رمز فردي مأخوذ من توزيع احتمالي معين ،

- الانتروبيا لتوزيع احتمالي معين للرسائل أو الرموز ، و

- معدل الانتروبيا لعملية عشوائية.

(يمكن أيضًا تحديد «معدل المعلومات الذاتية» لتسلسل معين من الرسائل أو الرموز الناتجة عن عملية عشوائية معينة: سيكون هذا دائمًا مساويًا لمعدل الإنتروبيا في حالة العملية الثابتة .) تُستخدم كميات أخرى من المعلومات أيضًا لمقارنة أو ربط مصادر مختلفة من المعلومات.

من المهم عدم الخلط بين المفاهيم المذكورة أعلاه. غالبًا ما يكون واضحًا من السياق فقط ما هو المقصود. على سبيل المثال ، عندما يقول شخص ما أن «إنتروبيا» اللغة الإنجليزية حوالي 1 بت لكل حرف، فإنهم في الواقع يقومون بنمذجة اللغة الإنجليزية كعملية عشوائية ويتحدثون عن معدل الإنتروبيا الخاص بها. استخدم شانون نفسه المصطلح بهذه الطريقة.

إذا تم استخدام كتل كبيرة جدًا ، فقد يصبح تقدير معدل الإنتروبيا لكل حرف منخفضًا اصطناعياً لأن التوزيع الاحتمالي للتسلسل غير معروف تمامًا ؛ إنه مجرد تقدير. إذا نظر المرء إلى نص كل كتاب تم نشره على أنه تسلسل، مع كل رمز الذي هو نص كتاب كامل ، وإذا كان هناك N كتب منشورة ، وتم نشر كل كتاب مرة واحدة فقط، فإن تقدير احتمال كل كتاب هو 1/N ، والانتروبيا (−log2(1/N) = log2(N)) هي −log2(1/N) = log2(N) . كرمز عملي ، يتوافق هذا مع تعيين معرّف فريد لكل كتاب واستخدامه بدلاً من نص الكتاب كلما أراد الشخص الرجوع إلى الكتاب. هذا مفيد للغاية للتحدث عن الكتب، ولكنه ليس مفيدًا جدًا لتوصيف محتوى المعلومات لكتاب فردي، أو للغة بشكل عام: لا يمكن إعادة إنشاء الكتاب من معرّفه دون معرفة توزيع الاحتمالات ، أي ، النص الكامل لجميع الكتب. الفكرة الرئيسية هي أنه يجب مراعاة تعقيد النموذج الاحتمالي. تعقيد كولموغروف Kolmogorov هو تعميم نظري لهذه الفكرة يسمح بالنظر في محتوى المعلومات في تسلسل مستقل عن أي نموذج احتمالي معين ؛ يعتبر البرنامج الأقصر لجهاز آلة تورنغ يخرج التسلسل. إن الكود الذي يحقق معدل الانتروبيا لتسلسل لنموذج معين ، بالإضافة إلى دفتر الكود (أي النموذج الاحتمالي)، هو أحد هذه البرامج ، ولكنه قد لا يكون الأقصر.

تسلسل فيبوناتشي هو 1، 1، 2، 3، 5، 8، 13... يعامل التسلسل كرسالة وكل رقم كرمز ، هناك عدد من الرموز تقريبًا مثل عدد الأحرف في الرسالة ، مما يعطي إنتروبيا ما يقرب من log2(n) . يحتوي أول 128 رمزًا لتسلسل فيبوناتشي على إنتروبيا تقريبًا 7 بتات / رمز ، ولكن يمكن التعبير عن التسلسل باستخدام صيغة [ F(n) = F(n−1) + F(n−2) لـ n = 3, 4, 5, … ، F(1) =1 ، F(2) = 1 ] وهذه الصيغة لها إنتروبيا أقل بكثير وتنطبق على أي طول لتسلسل فيبوناتشي.

نهايات الانتروبيا في التعمية

في تحليل التعمية، غالبًا ما يتم استخدام الإنتروبيا تقريبًا كمقياس لعدم القدرة على التنبؤ بمفتاح التعمية، على الرغم من أن عدم اليقين الحقيقي لا يمكن قياسه. على سبيل المثال ، يحتوي مفتاح 128 بت الذي يتم إنشاؤه بشكل موحد وعشوائي على 128 بت من انتروبي. يستغرق أيضًا (في المتوسط) التخمين لكسر بالقوة الغاشمة (brute force). فشل الانتروبي في التقاط عدد التخمينات المطلوبة إذا لم يتم اختيار المفاتيح المحتملة بشكل موحد. بدلاً من ذلك ، يمكن استخدام مقياس يسمى التخمين لقياس الجهد المطلوب لهجوم القوة الغاشمة.

قد تنشأ مشاكل أخرى من التوزيعات غير المنتظمة المستخدمة في التعمية. على سبيل المثال ، لوحة ثنائية رقمية مكونة من 1,000,000 تستخدم لوحة المرة الواحدة فقط. إذا كانت اللوحة تحتوي على 1,000,000 بت من انتروبي ، فهي مثالية. إذا كانت اللوحة تحتوي على 999,999 بت من الإنتروبيا ، موزعة بالتساوي (كل بتة فردية من اللوحة بها 0.999999 بت من الإنتروبيا) فقد يوفر أمانًا جيدًا. ولكن إذا كانت اللوحة تحتوي على 999,999 بت من الإنتروبيا ، حيث يتم إصلاح البت الأول و 999999 بت المتبقية بشكل عشوائي تمامًا ، فلن يتم تعمية البت الأول من نص التعمية على الإطلاق.

البيانات كعملية ماركوف

طريقة شائعة لتعريف الانتروبي لنص مبنية على نموذج ماركوف الخاص بالنص. بالنسبة لمصدر ترتيب-0 (order-0) (يتم تحديد كل حرف بشكل مستقل عن الأحرف الأخيرة)، فإن الانتروبي الثنائي هو:

حيث pi هو احتمال i . بالنسبة لمصدر ماركوف من الترتيب-الأول (first-order)(مصدر يعتمد فيه احتمال اختيار الحرف فقط على الحرف السابق مباشرة)، فإن معدل الإنتروبيا هو:

حيث i حالة (بعض الأحرف السابقة) و هو احتمال j بالنظر إلى الحرف i السابق.

بالنسبة لمصدر ماركوف من الترتيب الثاني (second order)، فإن معدل الإنتروبيا هو

انتروبي b-ary

بشكل عام الانتروبيا b لمصدر = (S, P) مع مصدر لأبجدية S = {a1, …, an و التوزيع الاحتمالي المتقطع P = {p1, …, pn حيث pi هو احتمال ai (ويقول pi = p(ai)) يعرف بما يلي:

ملاحظة: b في "انتروبي b-ary " هو عدد الرموز المختلفة للأبجدية المثالية المستخدمة كمقياس قياسي لقياس الحروف الأبجدية المصدر. في نظرية المعلومات ، هناك رمزان ضروريان وكافان لأبجدية لترمز المعلومات. لذلك ، فإن الوضع الافتراضي هو اعتبار b = 2 («إنتروبيا ثنائية»). وبالتالي ، فإن إنتروبيا الأبجدية المصدر ، مع توزيع الاحتمال التجريبي المعطى لها، هو رقم يساوي عدد (ربما كسري) لرموز «الأبجدية المثالية» ، مع توزيع احتمالي مثالي ، ضروري للترميز لكل رمز من رموز الأبجدية المصدر. لاحظ أيضًا: «التوزيع الاحتمالي الأمثل» هنا يعني توزيعًا موحدًا : الأبجدية المصدر برموز n لها أعلى إنتروبي ممكن (لأبجدية برموز n ) عندما يكون التوزيع الاحتمالي للأبجدية موحدًا. وتبين أن هذا الانتروبي الأمثل هو logb(n) .

الكفاءة (الانتروبيا المقيسة)

الأبجدية المصدر ذات التوزيع غير الموحد سيكون لها إنتروبيا أقل مما لو كانت هذه الرموز ذات توزيع منتظم (أي «الأبجدية المحسنة»). يمكن التعبير عن هذا النقص في الإنتروبيا كنسبة تسمى الكفاءة :

بتطبيق الخصائص الأساسية للوغاريتم ، يمكن التعبير عن هذه الكمية أيضًا على النحو التالي:

للكفاءة فائدة في تحديد الاستخدام الفعال لقناة اتصال . يشار إلى هذه الصيغة أيضًا باسم الإنتروبيا المقيسة ، حيث يتم تقسيم الإنتروبيا على أقصى إنتروبيا . علاوة على ذلك ، فإن الكفاءة غير مبالية في اختيار الاساس (الإيجابي) b ، كما يتضح من عدم الحساسية في اللوغاريتم النهائي أعلاه.

تمييز

تتميز إنتروبيا شانون بعدد قليل من المعايير المذكورة أدناه. أي تعريف للانتروبيا يستوفي هذه الافتراضات له الشكل

حيث K هو ثابت مطابق لاختيار وحدات القياس.

في ما يلي ، pi = Pr(X = xi) و Ηn(p1, …, pn) = Η(X) .

استمرارية

يجب أن يكون المقياس متواصلاً ، بحيث لا يؤدي تغيير قيم الاحتمالات بمقدار صغير جدًا إلا إلى تغيير الانتروبي بمقدار صغير.

تناظر

يجب ألا يتغير القياس إذا تم إعادة ترتيب النتائج xi .

- إلخ

الحد الأقصى

يجب أن يكون المقياس بأقصى حد إذا كانت جميع النتائج محتملة على قدم المساواة (يكون عدم اليقين أعلى عندما تكون جميع الأحداث المحتملة قابلة للتوازن).

بالنسبة للأحداث المتوازنة ، يجب أن يزيد الإنتروبيا مع عدد النتائج.

للمتغيرات العشوائية المستمرة ، فإن الغاوسي (Gaussian) متعدد المتغيرات هو التوزيع مع أقصى إنتروبيا تفاضلية .

الإضافة

يجب أن تكون كمية الإنتروبيا مستقلة عن كيفية اعتبار العملية مقسمة إلى أجزاء.

تميز هذه العلاقة الوظيفية الأخيرة إنتروبيا النظام مع الأنظمة الفرعية. تتطلب أن يتم حساب إنتروبيا النظام من إنتروبيا أنظمته الفرعية إذا كانت التفاعلات بين الأنظمة الفرعية معروفة.

لتكن فرقة من عناصر n موزعة بشكل متجانس التي تُقسم إلى مربعات k (النظم الفرعية) مع b1, ..., bk لكل عناصر b1, ..., bk ، يجب أن يكون الانتروبي من الفرقة بأكملها مساويا لمجموع الانتروبي من نظام الصناديق والانتروبيا الفردية للمربعات ، كل منها مرجح باحتمال وجوده في هذا الصندوق بالذات.

حيث للأعداد الصحيحة الموجبة bi حيث b1 + … + bk = n

اختيار k = n ، b1 = … = bn = 1 يعني أن إنتروبيا نتيجة معينة صفر: Η1(1) = 0 . هذا يعني أن كفاءة أبجدية المصدر برموز n يمكن تعريفها ببساطة على أنها تساوي إنتروبيا n -ary. انظر أيضًا الفائض (نظرية المعلومات) .

خصائص أخرى

تفي إنتروبيا شانون بالخصائص التالية ، بالنسبة لبعضها من المفيد تفسير الإنتروبيا على أنها كمية المعلومات المستفاد منها (أوالتخلص من الريبة) من خلال الكشف عن قيمة المتغير العشوائي X :

- لا تساهم إضافة أو إزالة حدث باحتمال الصفر في الإنتروبيا:

- انتروبيا متغير عشوائي متقطع هو رقم غير سالب:

- .[11] :15

- يمكن تأكيده باستخدام متراجحة ينسن كالتالي

- .[11] :29

- الانتروبيا الأقصى للوغاريتم logb(n) يتم تحقيقه بشكل فعال من خلال الأبجدية المصدر ذي التوزيع الاحتمالي الموحد: الريبة هي الحد الأقصى عندما تكون جميع الأحداث المحتملة قابلة للتوازن.

- الانتروبيا أو كمية المعلومات التي كشف عنها عن طريق تقييم (X,Y) (أي تقييم X و Y تزامنياً) تساوي المعلومات التي تم الكشف عنها من خلال إجراء تجربتين متتاليتين: أولاً تقييم قيمة Y ، ثم الكشف عن قيمة X بالنظر إلى أنك تعرف قيمة Y . يمكن كتابة هذا كـ

- وبالتالي ، يمكن أن ينخفض انتروبيا المتغير فقط عندما يتم تمرير الأخير من خلال دالة.

- إذا أين هي وظيفة ، إذن . تطبيق الصيغة السابقة على عائدات

وبالتالي ، يمكن أن ينخفض انتروبيا المتغير فقط عندما يتم تمرير الأخير من خلال دالة.

- إذا كان X و Y متغيرين عشوائيين مستقلين ، فإن معرفة قيمة Y لا تؤثر على معرفتنا بقيمة (نظرًا لأن الاثنين لا يؤثران على بعضهما البعض بالاستقلالية):

- لا يعد إنتروبيا حدثين متزامنين أكثر من مجموع إنتروبيا كل حدث فردي ، وهي متساوية إذا كان الحدثان مستقلين. وبشكل أكثر تحديدًا ، إذا كان X و Y متغيرين عشوائيين في نفس مساحة الاحتمال ، و (X, Y) يشيران إلى منتجهما الديكارتي ،

- الانتروبي مقعر في دالة الكتلة الاحتمالية ، بمعنى آخر

- لجميع دوال (وظائف) الكتلة الاحتمالية و .[11] :32

- وفقًا لذلك ، تكون وظيفة الإنتروبيا السالبة (سلبي) محدبة ، ويكون اقترانها المحدب هو تعبير جمع لوغرايتم LogSumExp .

توسيع الإنتروبيا المتقطعة إلى الحالة المستمرة

الانتروبيا التفاضلية

يقتصر انتروبيا شانون على متغيرات عشوائية تأخذ قيمًا متقطعة. الصيغة المقابلة لمتغير عشوائي مستمر مع دالة كثافة الاحتمال f(x) مع دعم نهائي أو لانهائي على الخط الحقيقي (real line) يتم تعريفه عن طريق القياس ، باستخدام الشكل أعلاه من الانتروبي كما هو متوقع:

يشار إلى هذه الصيغة عادةً باسم الإنتروبيا المستمرة أو الانتروبي التفاضلي . و السوابق (precursor) منالانتروبي مستمرة h[f] هو التعبير عن الدالة (وظيفية) Η في نظرية-H لبولتزمان .

على الرغم من أن التشابه بين كلتا الدالتين (الوظيفتين) إيحائي (suggestive)، إلا أنه يجب تحديد السؤال التالي: هل الإنتروبيا التفاضلية امتداد صحيح للانتروبيا المتقطعة لشانون؟ تفتقر الإنتروبيا التفاضلية إلى عدد من الخصائص التي تمتلكها إنتروبون شانون المتقطعة - يمكن أن تكون سلبية وقد اقترحت تصحيحات، لا سيما الحد من كثافة النقاط المنفصلة .

للإجابة على هذا السؤال ،التوصيل بين الدالتين (الوظيفتين) :

من أجل الحصول على مقياس نهائي (محدود) بشكل عام حيث يصل حجم الحاوية (bin size) إلى الصفر. في الحالة المتقطعة، يكون حجم الحاوية هو العرض (الضمني) لكل من صناديق n (النهائية أو اللانهائية) التي يُشار إلى احتمالاتها بواسطة pn . نظرًا لتعميم المجال المستمر ، يجب أن يكون العرض صريحًا.

للقيام بذلك ، ابدأ بدالة مستمرة f مقسمة إلى حاويات الحجم . من خلال نظرية القيمة المتوسطة ، توجد قيمة xi في كل صندوق بحيث

تكامل الدالة f يمكن تقريبه (بالمعنى الريماني) بواسطة

حيث النهاية هذه و «حجم الحاوية إلى الصفر» متساويين.

و سنستدل بـ

وتوسيع اللوغاريتم ، لدينا

كما لدينا Δ → 0 ،

ملحوظة؛ log(Δ) → −∞ كـ Δ → 0 ، يتطلب تعريفًا خاصًا للانتروبيا التفاضلية أو المستمرة:

والتي ، كما قيل من قبل ، يشار إليها باسم الانتروبي التفاضلي . هذا يعني أن الإنتروبيا التفاضلية ليست نهاية (حد) لإنتروبيا شانون لـ n → ∞ . بدلاً من ذلك ، فإنه يختلف عن نهاية إنتروبيا شانون من خلال إزاحة لانهائية (an infinite offset) (انظر أيضًا المقالة حول بُعد المعلومات )

الحد من كثافة النقاط المنفصلة

أتضح كنتيجة أنه، على عكس إنتروبيا شانون ، فإن الانتروبيا التفاضلية ليست بشكل عام مقياسًا جيدًا للريبة أو المعلومات. على سبيل المثال ، يمكن أن تكون الإنتروبيا التفاضلية سلبية ؛ كما أنها ليست ثابتة تحت التحولات المنسقة المستمرة ( continuous co-ordinate transformations). يمكن توضيح هذه المشكلة عن طريق تغيير الوحدات عندما تكون x متغيرة ذات أبعاد. وثم f(x) تأخذ الواحدات1/x . يجب أن تكون قيمة اللوغاريتم بلا أبعاد ، وإلا فهي غير مناسبة ، بحيث تكون الإنتروبيا التفاضلية كما هو موضح أعلاه غير مناسبة. إذا كانت Δ هي قيمة «معيارية» لـ x (أي «حجم الحاوية») وبالتالي لديها نفس الوحدات ، عندئذ يمكن كتابة الانتروبي التفاضلي المعدل (modified differential entropy) في الشكل الصحيح على النحو التالي:

وستكون النتيجة هي نفسها لأي اختيار للوحدات لـ x . في الواقع ، حد الانتروبيا المتقطعة كما سيشمل أيضا مصطلح ، والتي ستكون بشكل عام لا نهائية. هذا أمر متوقع ، المتغيرات المستمرة عادة ما يكون لها إنتروبيا لانهائية عندما يتم تقسيمها. الكثافة المحدودة للنقاط المتقطعة هي في الواقع مقياس لمدى سهولة وصف التوزيع من التوزيع الموحد على مخطط القياس.

الانتروبيا النسبية

مقياس آخر مفيد للإنتروبيا يعمل بشكل جيد على قدم المساواة في الحالة المتقطعة والمستمرة هو الانتروبيا النسبية للتوزيع. يتم تعريفه على أنه انحراف كلباك-لايبا Kullback-Leibler من التوزيع إلى مقياس مرجعي m كالتالي. نفترض أن p توزيع الاحتمال المستمر على الإطلاق ( absolutely continuous) فيما يتعلق مقياس m أي هو من شكل p(dx) = f(x)m(dx) لبعض الدوال غير السلبية القابلة للتكامل m مرة (m -integrable) دالة f مع القابلة للتكامل m مرة (m-integral) 1، ثم يمكن تعريف الإنتروبيا النسبية على أنها

في هذا الشكل ، يعمم الإنتروبيا النسبية (حتى التغيير في الإشارة) كلاً من الإنتروبيا المتقطعة، حيث يكون المقياس m هو مقياس العد ، والانتروبيا التفاضلية ، حيث المقياس m هو مقياس ليبيج Lebesgue . إذا كان المقياس m هو نفسه توزيع احتمالي ، فإن الإنتروبيا النسبية غير سالبة ، وصفر إذا كان p = m كمقاييس. يتم تعريفه لأي مساحة قياس، وبالتالي تنسيق مستقل وثابت تحت إعادة تنسيق المعلمات (reparameterizations) إذا أخذ المرء في الاعتبار بشكل صحيح تحويل المقياس m . الإنتروبيا النسبية ، والانتروبيا الضمنية والانتروبيا التفاضلية ، تعتمد على مقياس «المرجع» m .

استخدم في التوافيق

أصبحت الانتروبيا كمية مفيدة في التوافيق.

متراجحة- لوميس ويتني

مثال بسيط على ذلك هو دليل بديل على متراجحة لوميس ويتني : لكل مجموعة فرعية A ⊆ Zd ، لدينا

حيث Pi هو الإسقاط المتعامد في الإحداثية i :

يتبع الدليل كنتيجة طبيعية بسيطة من عدم مساواة شيرر : إذا X1, …, Xd متغيرات عشوائية S1, …, Sn هي مجموعات فرعية من {1, …, d بحيث كل عدد صحيح بين 1 و تقع d في بالضبط r من هذه المجموعات الفرعية ، ثم

حيث هو المنتج الديكارتي للمتغيرات العشوائية Xj مع الفهارس j في Si (لذا فإن أبعاد هذا المتجه يساوي حجم Si ).

نحن نرسم كيف يتبع لوميس ويتني من هذا: في الواقع ، لتكنX يكون متغيرًا عشوائيًا موزعًا بشكل موحد مع قيم في A بحيث تحدث كل نقطة في A باحتمال متساوٍ. ثم (من خلال خصائص الانتروبيا المذكورة أعلاه) Η(X) = log|A|، حيث |A| يدل على طويلة A (عدد العناصر في المجموعة A). لتكن Si = {1, 2, …, i−1, i+1, …, d }. مجال لـ محتوى في Pi(A) وبالتالي . استخدم هذا الآن لتقييد الجانب الأيمن من متراجحة شيرر ( Shearer's inequality) و أرفع للأس الطرف المقابل للنتيجة التي تحصل عليها.

التقريب لمعامل ذي الحدين (binomial coefficient)

للأعداد الصحيحة 0 < k < n لتكن q = k/n .أي

حيث

- [12] :43

هنا برهان تخطيطي. لاحظ أن هو مصطلح واحد للتعبير

إعادة الترتيب يعطي الحد الأعلى (upper bound). بالنسبة إلى الحد السفلي ، يُظهر أولاً ، باستخدام بعض الجبر ، الذي هو أكبر مصطلح في الجمع. ولكن بعد ذلك ،

نظرًا لوجود مصطلحات n + 1 في التجميع. إعادة الترتيب يعطي الحد الأدنى.

التفسير الدقيق لهذا هو أن عدد السلاسل الثنائية للطول n مع k العديد من 1 هو تقريبًا .[13]

انظر أيضًا

- إنتروبيا شرطية

- إنتروبيا وسهم الزمن

- ترميز إنتروبي – a coding scheme that assigns codes to symbols so as to match code lengths with the probabilities of the symbols.

- تاريخ الإنتروبيا

- هندسة معلومية

- إنتروبي مشترك – is the measure how much entropy is contained in a joint system of two random variables.

- Kolmogorov–Sinai entropy in نظام تحريكيs

- معلومات متبادلة

- الإرباك

- Qualitative variation – other measures of تشتت for مستويات القياس

- عشوائية

المراجع

- ^ أ ب Shannon، Claude E. (يوليو 1948). "A Mathematical Theory of Communication". Bell System Technical Journal. ج. 27 ع. 3: 379–423. DOI:10.1002/j.1538-7305.1948.tb01338.x.

- ^ أ ب Shannon، Claude E. (أكتوبر 1948). "A Mathematical Theory of Communication". Bell System Technical Journal. ج. 27 ع. 4: 623–656. DOI:10.1002/j.1538-7305.1948.tb00917.x. (PDF, archived from here)

- ^ Pathria، R. K.؛ Beale، Paul (2011). Statistical Mechanics (Third Edition). Academic Press. ص. 51. ISBN:978-0123821881. مؤرشف من الأصل في 2020-06-17.

- ^ Schneier, B: Applied Cryptography, Second edition, John Wiley and Sons.

- ^ Borda, Monica (2011). Fundamentals in Information Theory and Coding. Springer. ISBN:978-3-642-20346-6. مؤرشف من الأصل في 2017-02-15.

- ^ Han, Te Sun & Kobayashi, Kingo (2002). Mathematics of Information and Coding. American Mathematical Society. ISBN:978-0-8218-4256-0. مؤرشف من الأصل في 2017-02-15.

{{استشهاد بكتاب}}: صيانة الاستشهاد: أسماء متعددة: قائمة المؤلفين (link) - ^ Schneider, T.D, Information theory primer with an appendix on logarithms, National Cancer Institute, 14 April 2007. نسخة محفوظة 14 يونيو 2020 على موقع واي باك مشين.

- ^ Carter، Tom (مارس 2014). An introduction to information theory and entropy (PDF). Santa Fe. مؤرشف من الأصل (PDF) في 2016-06-04. اطلع عليه بتاريخ 2017-08-04.

{{استشهاد بكتاب}}: صيانة الاستشهاد: مكان بدون ناشر (link) - ^ Mark Nelson (24 أغسطس 2006). "The Hutter Prize". مؤرشف من الأصل في 2018-03-01. اطلع عليه بتاريخ 2008-11-27.

- ^ أ ب "The World's Technological Capacity to Store, Communicate, and Compute Information", Martin Hilbert and Priscila López (2011), ساينس, 332(6025); free access to the article through here: martinhilbert.net/WorldInfoCapacity.html نسخة محفوظة 7 يناير 2016 على موقع واي باك مشين.

- ^ أ ب ت Thomas M. Cover؛ Joy A. Thomas (18 يوليو 2006). Elements of Information Theory. Hoboken, New Jersey: Wiley. ISBN:978-0-471-24195-9.

- ^ Aoki, New Approaches to Macroeconomic Modeling.

- ^ Probability and Computing, M. Mitzenmacher and E. Upfal, Cambridge University Press

This article incorporates material from Shannon's entropy on PlanetMath, which is licensed under the Creative Commons Attribution/Share-Alike License.

قراءة متعمقة

كتب عن نظرية المعلومات

- Arndt، C. (2004) ، مقاييس المعلومات: المعلومات ووصفها في العلوم والهندسة ، Springer ، (ردمك 978-3-540-40855-0)

- Cover ، TM ، Thomas ، JA (2006) ، عناصر نظرية المعلومات ، الطبعة الثانية. وايلي-إنترسينس. (ردمك 0-471-24195-4) رقم ISBN 0-471-24195-4 .

- Gray ، RM (2011) ، نظرية الانتروبيا والمعلومات ، Springer.

- ماكاي ، ديفيد جي سي . نظرية المعلومات والاستدلال وخوارزميات التعلم كامبريدج: مطبعة جامعة كامبريدج ، 2003. (ردمك 0-521-64298-1) رقم ISBN 0-521-64298-1

- Martin, Nathaniel F.G. & England, James W. (2011). Mathematical Theory of Entropy. Cambridge University Press. ISBN:978-0-521-17738-2. مؤرشف من الأصل في 2020-08-03.

{{استشهاد بكتاب}}: صيانة الاستشهاد: أسماء متعددة: قائمة المؤلفين (link) Martin, Nathaniel F.G. & England, James W. (2011). Mathematical Theory of Entropy. Cambridge University Press. ISBN:978-0-521-17738-2. مؤرشف من الأصل في 2020-08-03.{{استشهاد بكتاب}}: صيانة الاستشهاد: أسماء متعددة: قائمة المؤلفين (link) Martin, Nathaniel F.G. & England, James W. (2011). Mathematical Theory of Entropy. Cambridge University Press. ISBN:978-0-521-17738-2. مؤرشف من الأصل في 2020-08-03.{{استشهاد بكتاب}}: صيانة الاستشهاد: أسماء متعددة: قائمة المؤلفين (link) - شانون ، CE ، Weaver ، W. (1949) النظرية الرياضية للاتصال ، مطبعة جامعة إلينوي. (ردمك 0-252-72548-4) رقم ISBN 0-252-72548-4

- Stone ، JV (2014) ، الفصل الأول من نظرية المعلومات: مقدمة تعليمية ، جامعة شيفيلد ، إنجلترا. (ردمك 978-0956372857) رقم ISBN 978-0956372857 .

روابط خارجية

- Hazewinkel، Michiel، المحرر (2001)، "Entropy"، Encyclopedia of Mathematics، سبرنجر، ISBN:978-1-55608-010-4 Hazewinkel، Michiel، المحرر (2001)، "Entropy"، Encyclopedia of Mathematics، سبرنجر، ISBN:978-1-55608-010-4

- مقدمة في الإنتروبيا ومعلومات عن Principia Cybernetica Web

- الانتروبيا مجلة متعددة التخصصات حول جميع جوانب مفهوم انتروبي. الوصول المفتوح.

- وصف انتروبي من المعلومات من «أدوات للفكر» هوارد راينجولد

- بريمج جافا يمثل تجربة شانون لحساب الانتروبيا من اللغة الإنجليزية

- شرائح على كسب المعلومات و إنتروبيا

- دليل بديهي لمفهوم الانتروبيا الناشئة في قطاعات مختلفة من العلوم - كتاب ويكي على تفسير مفهوم انتروبي.

- اكتشاف أحداث الشبكة باستخدام تدابير الانتروبيا ، د. رايموند إيمان ، جامعة أوكلاند ، PDF ؛ 5993 كيلو بايت - أطروحة دكتوراه توضح كيفية استخدام تدابير الانتروبيا في الكشف عن الشذوذ في الشبكة.

- "Entropy" في Rosetta Code - مراجعة تطبيقات إنتروبي شانون بلغات برمجة مختلفة.

- «نظرية المعلومات للأشخاص الأذكياء» . مقدمة قصيرة لبديهيات نظرية المعلومات ، الإنتروبيا ، المعلومات المتبادلة ، اختلاف كولباك - ليبلر ، ومسافة جنسن - شانون.

- أداة على الإنترنت لحساب الإنتروبيا (نص عادي)

- أداة على الإنترنت لحساب الإنتروبيا (ثنائي)

| اعتلاج في المشاريع الشقيقة: | |